맥에서 오픈소스로

Ollama 에서 이미지 이해시키기 본문

- 이미지 분석 요청은 아래 명령처럼 하면 됩니다. 이미지는 저렇게 로컬의 절대경로를 올려주면 되구요. 아마 URL 링크 이미지도 분석이 가능할겁니다.

>>> what's inside in this photo? /Users/m1_16/Desktop/89928895.1.jpg

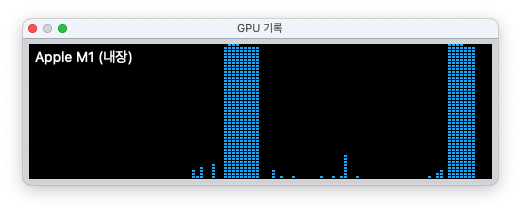

질문을 던질때 마다 저렇게 실리콘맥의 GPU는 열일을 하게됩니다~

The image shows a ceramic vase that appears to be of historical

significance or a museum piece. It has a traditional shape with a narrow

neck and a wider body, which is typical for ancient Chinese pottery.

There's an intricate decoration on the side that looks like stylized plant

life, and there is also some text or markings visible on the vase, which

could indicate its age, origin, or cultural significance. The color of the

vase is a soft blue-green hue, suggesting it might be made from materials

rich in cobalt oxide, which was often used to create such colors on

Chinese ceramics.

- 한글 번역:'딥러닝' 카테고리의 다른 글

| 퍼플렉시티와 끌로드에 다음 질문을 던졌습니다. (8) | 2024.09.14 |

|---|---|

| [파이썬] ComfyUI에 이미지 스펙트럼 노드를 만들어 보았습니다. (4) | 2024.09.12 |

| [파이썬] Focal Loss 로 Resnet 모델 학습하기 (11) | 2024.09.11 |

| 알파채널을 적용한 GradCAM 히트맵 (4) | 2024.09.10 |

| ComfyUI로 합성데이타 생성하기 (3) | 2024.09.10 |